Apple a présenté une nouvelle expérience de recherche avec Apple Intelligence, baptisée Apple Visual Intelligence. Elle ressemble à Google Lens, mais utilise l'appareil photo natif de l'iPhone et est directement intégrée à Apple Intelligence.

De plus, il semble utiliser des fournisseurs de recherche tiers, comme Google, ChatGPT d'OpenAI et Yelp pour ses résultats de recherche, en fonction du type de requête.

À quoi ça ressemble. Voici quelques captures d'écran que j'ai attrapé depuis l'événement Apple d'hier, si vous voulez le regarder, il commence à environ 57 minutes cette vidéo:

Vous cherchez à acheter un vélo que vous avez vu lors de votre promenade ; il est indiqué « Recherche avec Google… » après avoir pris une photo :

Bien que l’exemple fourni des résultats de recherche semble quelque peu « trafiqué » :

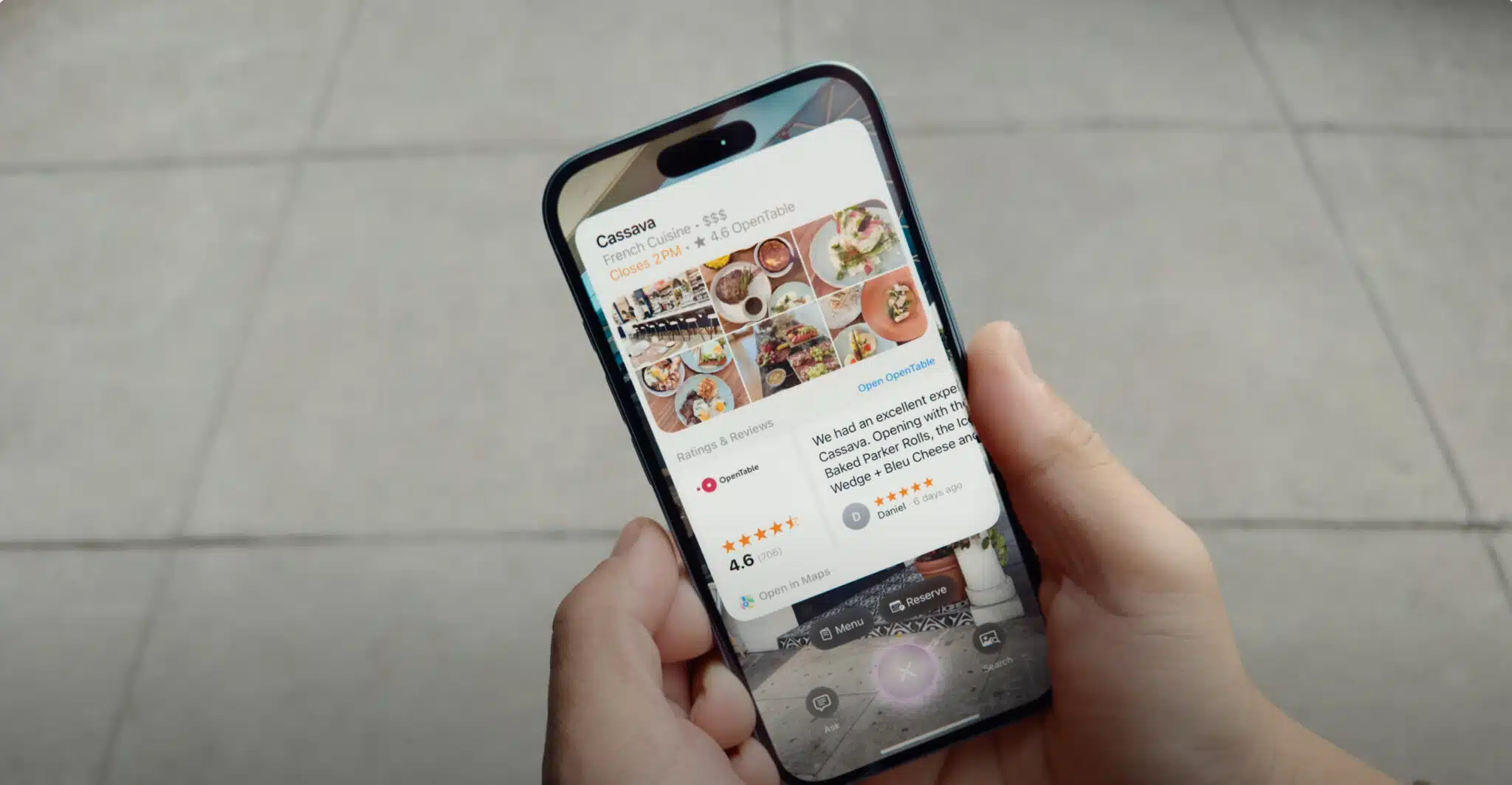

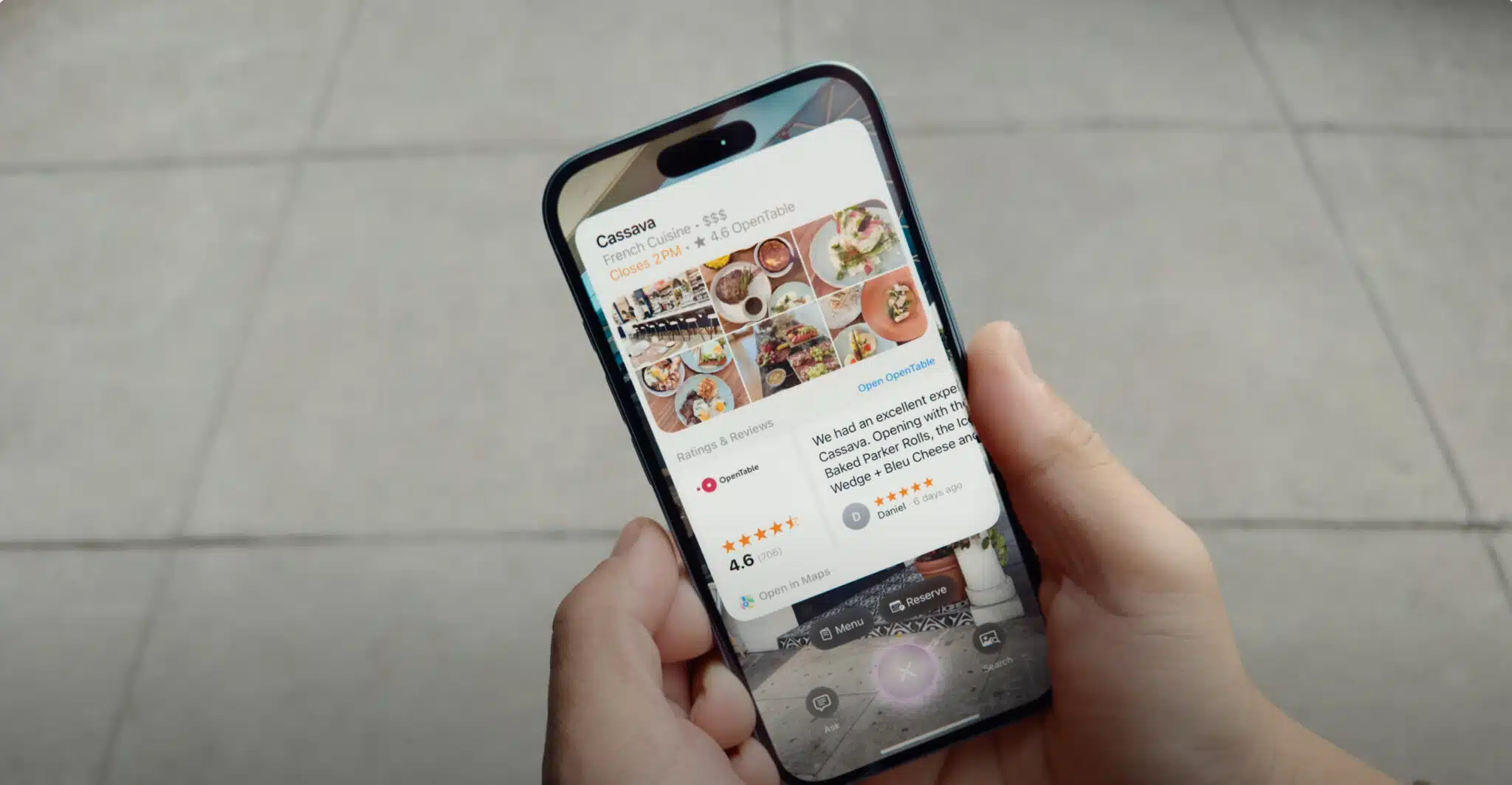

Voici un exemple de résultat de recherche locale lorsque quelqu'un souhaite obtenir plus de détails sur un restaurant qu'il a croisé en marchant. Cela semble faire apparaître les résultats de recherche locale dans Apple Maps, qui, je crois, est alimenté par Yelp et OpenTable.

Voici un gros plan montrant les options OpenTable dans Apple Maps :

Voici un exemple de prise de photo d'un devoir à la maison, où ChatGPT d'OpenAI est utilisé pour obtenir de l'aide :

Pourquoi nous nous en soucions. Apple semble utiliser l'IA comme un outil plutôt que comme une base pour ses appareils, où elle s'intègre à Google, OpenAI et d'autres fournisseurs de recherche. Il y a évidemment de l'IA sous-jacente et de l'apprentissage automatique qui se déroulent sur l'appareil Apple, mais les résultats semblent provenir de tiers.

Une première évaluation de la version bêta de Washington Post suggère qu'il reste encore beaucoup de chemin à parcourir. Plus précisément, il y a des problèmes avec les hallucinations, le marquage des courriers indésirables comme prioritaires et d'autres problèmes.