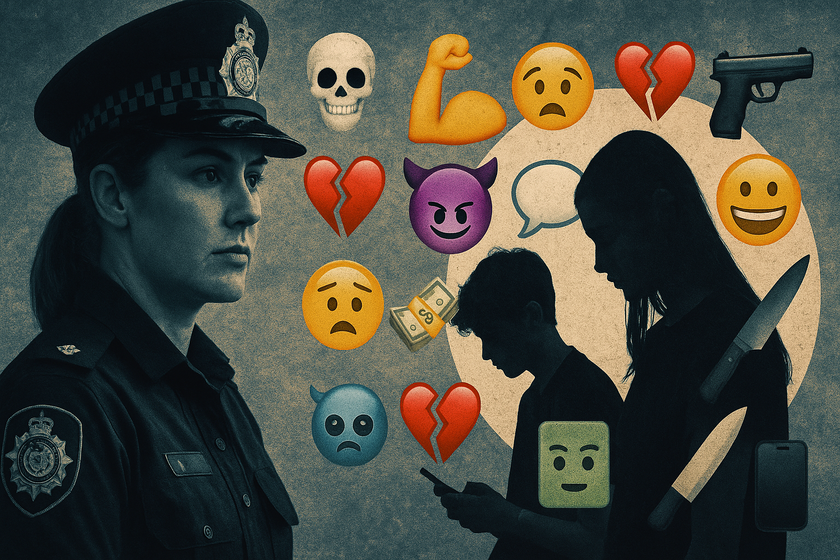

La police fédérale australienne (AFP) a annoncé le développement d’une intelligence artificielle pionnière capable d’interpréter les émojis et l’argot numérique utilisés par les jeunes générations – Gen Z et Gen Alpha – sur les plateformes cryptées et les réseaux sociaux. Leur objectif : décrypter le nouveau code symbolique avec lequel les jeunes criminels communiquent et qu'ils utilisent pour dissimuler leurs activités illégales.

Une nouvelle frontière dans le langage de la criminalité numérique

La commissaire Krissy Barrett, nouvelle directrice de l'AFP, a révélé l'initiative lors d'une conférence au National Press Club. Comme il l'a expliqué, le projet cherche à comprendre comment les groupes criminels émergents communiquent à travers des symboles, des mèmes et des emojis, un langage en constante mutation qui fait désormais partie de l'écosystème de la cybercriminalité des jeunes.

« Nous développons un prototype d'IA capable d'interpréter les émojis et l'argot des générations Z et Alpha dans les communications cryptées et les groupes de discussion, afin de détecter l'exploitation en ligne de contenus violents. »

La menace des « influenceurs du crime »

Le déclencheur de cette évolution est la prolifération des « crimefluencers », des communautés numériques qui glorifient la violence, le sadisme et l'extrémisme. Selon Barrett, il s’agit de réseaux décentralisés sans idéologie définie, mais unis par la fascination du chaos et de l’autodestruction.

Ces communautés, majoritairement composées d'adolescents, utilisent des systèmes de gamification pour grimper au sein de leurs groupes : plus les contenus qu'elles partagent sont extrêmes et cruels, plus leur statut est élevé. Dans certains cas, les « candidats » doivent passer des tests macabres, comme la diffusion de vidéos d’automutilation ou de violence envers autrui.

Dans ce contexte, les emojis et l’argot des jeunes fonctionnent comme une sorte de hiéroglyphe criminel. Des icônes apparemment innocentes peuvent cacher des références à la drogue, aux armes, à l’automutilation ou à l’agression.

Décoder ce langage est devenu une priorité pour les forces de sécurité, notamment lorsque les conversations sont cryptées ou circulent dans des environnements difficiles à surveiller comme Snapchat, Discord ou les chaînes fermées de Telegram.

L'intelligence artificielle pour détecter d'autres IA

L'IA de l'AFP ne se limite pas à traduire des emojis. Il fait partie d'un ensemble plus large d'outils visant à automatiser l'analyse des communications numériques et à détecter les modèles d'exploitation des enfants, de terrorisme ou de cybercriminalité. Selon Barrett, les équipes de l'AFP sont confrontées à un défi croissant : faire la distinction entre les images réelles d'abus et les contenus générés par l'IA :

« Nos agents doivent déterminer s'il s'agit d'un véritable enfant exploité ou s'il s'agit d'une image synthétique », a-t-il déclaré. « Les deux cas sont atroces, mais ils nécessitent des réponses différentes. »

Travail conjoint avec l'industrie et le monde universitaire

L’AFP renforce sa coopération avec des entreprises technologiques – notamment Microsoft – et des institutions académiques pour améliorer ses capacités de détection et d’analyse. « Il y a des projets que je ne peux pas encore rendre publics », a admis Barrett, compte tenu du caractère sensible de certaines enquêtes en cours.

L’augmentation de la criminalité basée sur l’IA – des deepfakes à la fraude d’identité en passant par l’extorsion numérique – a contraint la police australienne à adopter une approche plus technologique et préventive. Les départements de cybercriminalité et d’exploitation des enfants travaillent désormais main dans la main avec des data scientists, des linguistes et des psychologues numériques.

Un phénomène mondial

L'Australie collabore également avec d'autres pays : à travers le groupe de coopération policière « Cinco Ojos » (le nom semble provenir des films de 007mais c'est réel), les autorités des États-Unis, du Royaume-Uni, du Canada et de la Nouvelle-Zélande travaillent avec elles pour traquer les réseaux de jeunes radicalisés et les nouvelles formes de communication criminelle.

Enjeux éthiques et opérationnels

Même si l’idée d’une IA policière qui « traduirait les émojis » puisse paraître anodine, voire humoristique, elle soulève de sérieux dilemmes éthiques et techniques. D’une part, la surveillance numérique du langage implique d’entrer dans des zones grises de la vie privée et de la liberté d’expression. D’un autre côté, la nature éphémère et changeante du jargon des jeunes nécessite des modèles d’IA qui apprennent et se mettent constamment à jour, sans tomber dans des préjugés ou des interprétations erronées.

À Xataka | Incel ? Androsphère ? Et ces émojis ? Ceci est votre guide pour comprendre la mini-série populaire de Netflix « Adolescence »