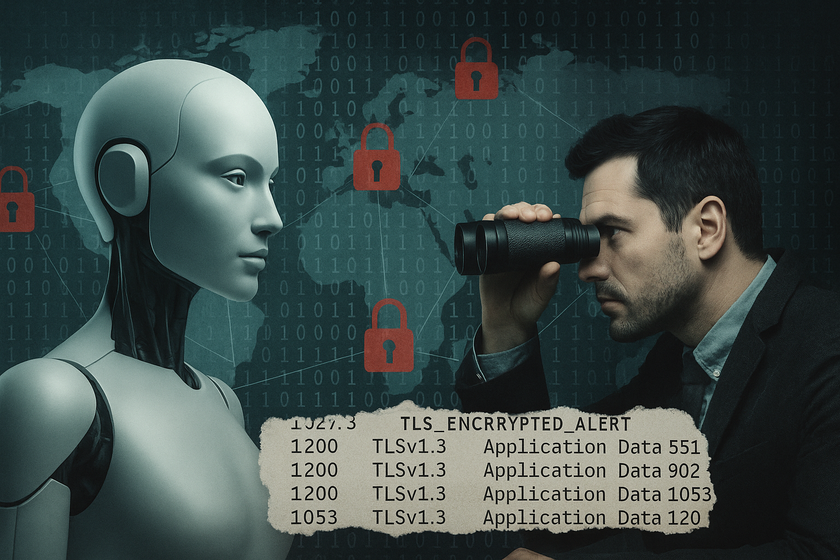

Il y a quelques jours, une équipe de chercheurs de Microsoft a annoncé une découverte qui a surpris à la fois le secteur de l'IA et celui de la cybersécurité : l'existence d'un type de cyberattaque appelé « Whisper Leak », capable de déduire le sujet des conversations entre utilisateurs et des modèles de langage – comme ChatGPT ou Gemini – même lorsque ces communications sont protégées par le cryptage TLS.

La découverte n'implique pas une défaillance du chiffrement lui-même, mais plutôt ce qu'on appelle un filtration par canal latéral (soit fuite par canal latéral) : une forme d'écoute clandestine qui ne rompt pas le chiffrement, mais tire plutôt parti des signaux indirects du trafic réseau, tels que la taille des paquets et les intervalles de temps qui les séparent, pour déduire ce qui se passe « derrière le verrou ».

L’étude révèle que la vulnérabilité est systémique et transversale : elle affecte de nombreux modèles économiques, dont ceux de grands fournisseurs comme OpenAI, Anthropic, Google, AWS, DeepSeek et Alibaba.

Qu’est-ce qu’un canal secondaire exactement ?

Une attaque par canal secondaire n’accède pas au contenu d’un message, mais observe plutôt ses schémas. En cryptographie classique, ces attaques servaient à voler des clés en analysant la consommation électrique d'une puce ou les variations temporelles au cours d'une opération.

Dans le cas des modèles linguistiques, le canal secondaire naît de la manière même dont les systèmes génèrent et transmettent du texte : de manière séquentielle et en temps réel. Chaque mot ou fragment (boufféen) le modèle généré est envoyé immédiatement à l'utilisateur, pour offrir une expérience « transparente ».

Bien que tout le trafic soit crypté, la taille et la cadence de ces fragments ne sont pas masquées. Tout comme il écoute le rythme d’une conversation sans en comprendre les mots, un attaquant peut reconnaître (en utilisant, à son tour, des IA spécifiquement entraînées) certains modèles statistiques qui révèlent le sujet abordé.

Comment fonctionne Whisper Leak

Les chercheurs de Microsoft ont conçu une expérience avec un objectif précis : voir s'ils pouvaient identifier des conversations sur un sujet sensible – en l'occurrence, « la légalité du blanchiment d'argent » – simplement en observant le trafic crypté. Pour ce faire :

- Ils ont généré 100 variantes de questions sur ce sujet (« Est-il illégal de blanchir de l'argent ? », « Existe-t-il des exceptions aux lois sur le blanchiment d'argent ? », etc.).

- Ils les ont mélangés à plus de 11 000 questions aléatoires, pour simuler un environnement réel avec du bruit.

- Ils ont enregistré le trafic réseau à l'aide de l'outil tcpdump tandis que les modèles répondaient, économisant uniquement la taille des paquets et le temps qui les séparait.

- Enfin, ils ont entraîné trois types de modèles d'apprentissage automatique (LightGBM, Bi-LSTM et une version modifiée de BERT) pour classer le trafic en deux catégories : « sujet sensible » ou « autres sujets ».

Le résultat était alarmant : dans 17 des 28 modèles testés, les classificateurs ont atteint une précision supérieure à 98 %. Même dans des conditions réalistes (une conversation sensible parmi 10 000 normales), certains modèles ont permis une détection parfaite de 5 à 20 % des conversations sur le sujet cible, sans faux positifs.

Concrètement, cela signifie qu'un observateur du réseau (par exemple, un fournisseur d'accès Internet ou un gouvernement autoritaire) pourrait identifier avec une grande certitude lorsqu'un utilisateur parle de sujets considérés comme « sensibles » – comme la politique, les manifestations ou le journalisme – sans avoir besoin de briser le cryptage.

Quels modèles sont protégés (et lesquels ne le sont pas)

Selon Microsoft, plusieurs fournisseurs ont déjà mis en œuvre des mesures d'atténuation efficaces, notamment :

- Microsoft (Azure OpenAI)

- OpenAI (ChatGPT, GPT-4o, o1-mini)

- Mistral

- xAI (Grok)

Ces services ont ajouté un champ d'obscurcissement à leurs API, qui introduit du texte aléatoire ou de faux jetons dans les réponses pour fausser les modèles de taille et de timing. Cette technique, inspirée d'une précédente solution Cloudflare, réduit l'efficacité de l'attaque « à des niveaux qui ne représentent plus un risque pratique ».

Les chercheurs ont eux-mêmes testé trois stratégies défensives :

- Remplissage aléatoire – Ajoutez des octets supplémentaires pour masquer la taille réelle des paquets.

- Regroupement de jetons – Envoyez plusieurs jetons à la fois, réduisant ainsi la granularité temporelle du trafic.

- Fake Packet Injection – Envoyez des données synthétiques à des moments aléatoires pour confondre les modèles temporels.

Tous réduisent l’efficacité de l’attaque, mais aucun ne l’élimine complètement sans sacrifier les performances ou la latence.